奥本 AI 将所有的最新 AI 聚合到了一起,为您开启多模型 AI 绘画新时代!

扫码即刻关注公众号

提示工程已经死了吗?真的是这样吗?

6 个月前

Prompt Engineering is Dead! Is it?

Prompt Engineering,即提示工程,是一种在人工智能领域中,特别是在自然语言处理(NLP)中使用的技术。它涉及到设计和优化用于引导人工智能系统生成特定输出的提示或问题。然而,有些人可能会认为Prompt Engineering已经过时或不再有效,但这种观点可能并不准确。

为什么有人认为Prompt Engineering已死?

- 技术进步:随着深度学习和大型语言模型的发展,一些任务可能不再需要精心设计的提示。

- 自动化:某些系统可能已经能够自动生成高质量的输出,减少了对人工设计的提示的依赖。

- 用户习惯:随着用户对AI系统的熟悉度提高,他们可能更倾向于直接与系统交互,而不是依赖提示。

但是,Prompt Engineering真的死了吗?

- 定制化需求:尽管技术在进步,但特定领域或特定任务可能仍然需要定制化的提示来获得最佳结果。

- 解释性和可控性:精心设计的提示可以帮助提高AI系统的解释性和可控性,这对于某些应用场景至关重要。

- 创新和创造力:Prompt Engineering可以激发新的创意和方法,推动AI技术的发展。

未来我们将如何指导人工智能?

提示工程:我们是在鞭打一匹死马吗?图片来源:作者在Midjourney上的图片。 就像我们经过数月甚至数年终于开始掌握提示工程的艺术一样,有些人已经在说我们正在驾驭一匹病入膏肓的马。

他们认为,我们所熟知的提示工程(prompt engineering),在短短6个月内就会变得无关紧要,最多可能在2年内。它所解决的问题将以一种完全不同的方式得到解决,或者将不再存在 —— 尽管对于具体如何以及为什么会出现这种情况,意见和想法各不相同。 让我们更仔细地审视这些论点并评估它们的优点。提示工程仅仅是一个短暂的AI夏季热门吗?还是它将长期存在?在未来几年中,它将如何变化和发展? Prompt Engineering 是什么,我们为什么应该关心它?

Prompt Engineering 是一种技术,它涉及到设计和优化用于人工智能(AI)系统的提示或问题,以提高AI的响应质量和准确性。这种技术特别适用于自然语言处理(NLP)领域,其中AI系统需要理解和生成人类语言。

我们关心Prompt Engineering的原因有以下几点:

- 提高AI的理解和响应能力:通过精心设计的提示,AI可以更准确地理解用户的意图,并提供更相关和准确的回答。

- 增强用户体验:当AI能够更好地理解并回应用户的需求时,用户的体验会得到显著提升。

- 优化AI性能:通过优化提示,可以减少AI系统在处理语言时的错误,从而提高整体性能。

- 适应性:Prompt Engineering 允许AI系统更好地适应不同的语言风格和用户群体,提供定制化的服务。

- 教育和培训:在教育领域,Prompt Engineering 可以帮助设计更有效的教学提示,以提高学习效果。

- 商业应用:在商业环境中,通过优化客户服务对话的提示,可以提高客户满意度和忠诚度。

总的来说,Prompt Engineering 是一种提高AI系统与

一个简单的提示,比如“ChatGPT,请写一封邮件给我的员工,表扬他们在2023年的利润增长,并同时以富有同情心的方式宣布大幅度裁员”,并不需要太多的提示工程。我们只需写下我们需要的,通常就能奏效。 然而,在应用或数据科学的背景下,提示工程变得至关重要。换句话说,当模型作为平台的一部分需要处理大量查询或更大、更复杂的数据集时,这是必不可少的。 在应用程序中,提示工程的目标通常是尽可能多地引发正确的响应,同时完全避免某些响应:例如,航空公司服务机器人中的提示模板应该如此精心设计,以至于机器人:

- 能够理解并正确回答乘客的常见问题,如航班状态、座位选择、行李规定等。

- 能够引导乘客通过对话流程,以完成预订、更改或取消航班等任务。

- 能够识别并避免提供敏感信息,如个人识别信息或安全细节。

- 能够以礼貌和专业的方式处理乘客的投诉和反馈。

- 能够在无法提供帮助时,将对话转接给人工客服。

- 能够根据上下文和用户需求,提供个性化的建议和解决方案。

通过精心设计的提示模板,航空公司服务机器人可以提高客户满意度,减少对人工客服的依赖,同时确保信息的准确性和安全性。 * 可以根据用户的问题检索相关信息 * 能够处理信息,为用户提供准确、易于理解、简洁的回答 * 可以决定它是否有能力回答一个问题,或者不能,并可以给用户一个指示在哪里找到额外的信息 * 永远不会让自己被用户操纵,以提供折扣、免费代金券、升级或其他好处 * 不参与关于政治、宗教或强制接种疫苗等离题话题的对话 * 不讲关于空乘人员和飞行员的含糊不清的笑话 * 不允许提示劫持 提示工程为模型提供了生成可理解格式响应所需的数据,指定了任务,描述了响应格式,提供了适当和不适当响应的示例,列出了主题白名单,定义了边缘情况,并防止了滥用用户提示。 除了一些关键短语外,这个提示并不依赖于触发模型中疯狂隐藏开关的神奇公式。相反,它以高度结构化的方式描述任务,就好像是在向一个仍然不熟悉我的公司、我的客户、我的产品以及所讨论任务的聪明新手解释一样。 那么,为什么说提示工程是一匹死马呢?

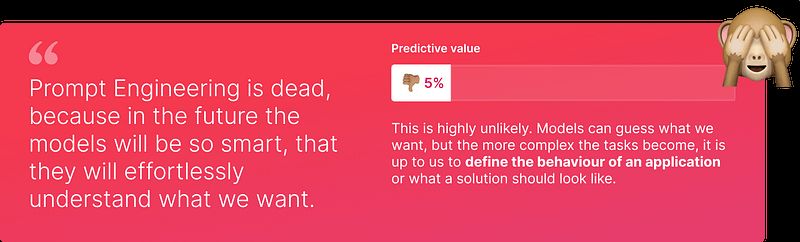

那些提出这一主张的人通常会给出几个原因,这些原因的侧重点各不相同。 给出的主要原因是: 1) 尽管问题表述对于模型仍然是必要的,但实际的提示制作——即选择正确的短语——正在变得不那么关键。 2)模型越来越擅长理解我们。 我们可以大致地用几个要点草拟出任务,并且得益于其智能,模型将自行推断出其余部分。 3) 这些模型将如此个性化,以至于它们比我自己更了解我,并且能够预测我的需求。 4) 模型将自主生成提示或改进我的提示。 5) 这些模型将被集成到代理设置中,使它们能够独立地制定解决问题的计划并检查解决方案。 6) 我们将不再编写提示,我们将编程**它们。 [生成式人工智能列表大全:5000个模型、工具、技术、应用和提示]

精选的生成性人工智能资源列表。更新日期:2024年6月1日 — 新模型

https://medium.com/@maximilian.vogel/5000x-generative-ai-intro-overview-models-prompts-technology-tools-comparisons-the-best-a4af95874e94)1) 提示工程已经过时。但模型的问题表述仍然需要,并且变得更加重要。

看起来您可能没有提供完整的句子或段落来翻译。如果您能提供更多信息或完整的句子,我将很乐意帮助您翻译。

例如,有人这样论证。 是的,是的,我同意:模型的问题表述确实是最重要的事情。 但那正是提示工程的核心组成部分:精确指定模型应该如何响应、处理数据等等。 这类似于软件开发并不是关于正确放置花括号,而是关于精确、无故障、易于理解的算法表述,以解决一个问题。

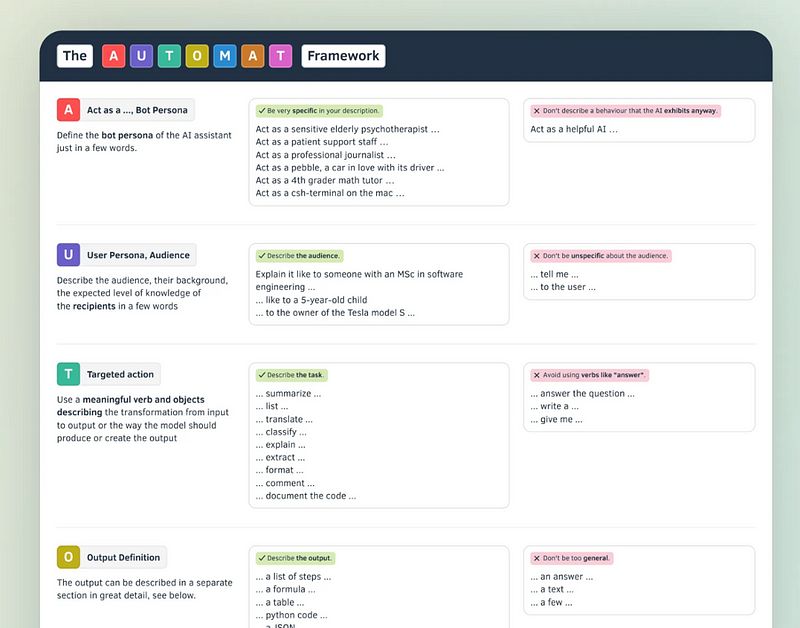

AUTO和以此类推 —— 在AUTOMAT框架中

prompt engineering cheat sheet

例如,上面的截图展示了AUTOMAT框架,它规定了如何构建提示指令。其中大约90%是清晰地并以正确的结构向模型传达任务。另外的10%是仙女的魔法尘——或者说是非常特别的表达方式,这些表达方式可以使你的提示更加成功。 那么,也许这并不是提示工程将如何消亡的方式。

2)模型将越来越理解我们。所以,在未来,我们将用几个要点来概述我们的任务给模型,模型将以某种方式理解我们。因为它非常聪明。

是一篇发表在Medium上的故事。

和

是一些Reddit上的讨论。 我认为我们都同意模型的能力将迅速发展:我们将能够让他们解决越来越复杂和广泛的任务。但现在让我们谈谈指令的质量和大小。 让我们假设我们有一些能够解决各种复杂度任务的精灵:一个可以为我变出一把勺子,第二个可以变出一套西装,第三个可以变出一辆车,第四个可以变出一栋房子,第五个可以变出一个城堡。我可能会更详细、更精确地向精灵们介绍任务,因为它们越好,目标越复杂。因为对于复杂物品,我的自由度比简单物品要高。 这正是情况。自从GPT-2以来,我一直在与生成性人工智能合作。我从未像今天这样花这么多时间在提示工程上。不是因为模型更笨,而是因为任务要求更高。 上述论点中唯一真实的事情是,随着模型的改进,提示工程变得更加高效:如果我在新模型上投入双倍的提示工程努力,我得到的输出在价值、复杂性和精确度上可能接近于我过去用旧模型所得到的四倍。 至少对我来说感觉就是这样。

3) 这些模型将被个性化并量身定制给我。所以它们将确切地知道我想要什么,我就不必向它们解释了。

这种观点有一定的道理。当我让一个未来的模型为我和妻子的五周年结婚纪念日推荐一个周末时,它已经知道我的妻子是素食主义者,我更喜欢山而不是海滩。并且我们现在手头有点紧,因为我们刚刚买了房子。我不再需要明确地说出来。 但我并不认为个性化的最大潜力在于与个人及其偏好和任务的关系。相反,它在于与组织、他们的商业案例和数据的关系。 想象一下,如果一个模型能够正确执行这样的指令:“请问特斯拉的团队是否已经将最后的交付物发给了客户,然后与财务部门确认我们何时可以开具最终发票?” 世界上最聪明的模型也无法执行这个指令,因为它不知道“特斯拉的家伙”(是特斯拉公司的项目吗?还是关于尼古拉的传记电影?),交付物是什么,以及“财务”到底是谁以及如何联系他们。 如果一个模型能够理解类似这样的内容,那将是一个游戏规则的改变者。它将成为一个有用的、全面技能的同事。一个有价值的、经验丰富的员工与一个新人(你更愿意投入时间的人)之间的差异通常不在于他们更广泛的领域知识,而在于他们的背景知识:他们了解我的组织的人、数据、流程。他们知道什么有效,什么无效,以及当事情不顺利时该找谁交谈。一个经验丰富的模型可以拥有这种背景知识。这将是难以置信的宝贵:全天候工作24小时,每小时仅需几美分。 这不仅对于像上面的特斯拉指令这样的临时工作有用,而且在应用程序上下文中也很有用,例如,在建立一个基于AI的结构化系统来处理保险索赔时:一个知道我们保险公司索赔部门如何处理客户电子邮件的模型可能会非常有帮助。例如,它可以协助设置算法和提示,以实现自动化处理。 目前,尚不清楚模型如何获得这些知识。使用结构化的训练材料进行传统的微调肯定需要在数据提供方面付出太多的努力。让模型持续跟踪一个团队或部门的对话和消息可能是一个解决方案。也许你有更好的想法? 即使拥有个人模型,这并不意味着我不需要进行任何提示工程。但我可以让模型或其嵌入的系统为我承担很多繁重的工作。

4)模型将编写自己的提示,或者至少优化我们的提示

我们已经看到,这并不容易,因为模型无法知道我想要什么,以及我确切地想要它怎样。 但有一件事可以帮助我们:我们不是给模型一个指令告诉它做什么,而是可以简单地用例子轰炸它,让它自己写一个提示。例如,这里我让模型根据输入输出对给我写一个提示: ```

Instruction

Act as a smart prompt engineer. Write a prompt for me, that could translate all of the following inputs into the outputs. If it makes sense for your, add more input / output examples which are not too close to the existing examples. Format everything to a well crafted prompt

Input / Output

Input: 'Fagoideae', Output: 'Fagaceae'

Input: 'Washington', Output: '

这里是模型输出(GPT-4o): ```

Prompt

You are a highly accurate biological classification translator. Your task is

to translate inputs representing biological taxa into their correct higher

taxonomic group. If the input does not represent a valid biological taxon,

respond with '

Input: 'Fagoideae' Output: 'Fagaceae'

Input: 'Washington'

Output: '

Input: 'Ciconiidae' Output: 'Ciconiiformes'

Input: 'Pizza'

Output: '

Input: 'Fungi' Output: 'Eukaryota'

Additional Examples:

Input: 'Felidae' Output: 'Carnivora'

Input: 'Hominidae' Output: 'Primates'

Input: 'Canis' Output: 'Carnivora'

Input: 'Table'

Output: '

Input: 'Chordata' Output: 'Animalia'

Translate the following input accordingly:

Input: ```

提示非常好。例如,第一条指令包含了一些作为提示工程师的我可能不知道也不需要知道的东西——这里的模型以一种巧妙的方式概括了我的示例:

Your task is to translate inputs representing biological taxa into their

correct higher taxonomic group. If the input does not represent a valid

biological taxon, respond with '<WRONG INPUT>'.

这个模型仅从示例中推断出这些信息——我没有明确提供这种概括。而且它找到了一些比我提供的更好、更引人注目的例子。 然而,这个提示仍然需要一些改进。例如,你不会以“### 提示”开始,因为你要发送的模型总是知道这是提示。此外,“额外示例”这样的标题在提示中没有意义,但只在提示工程师和PE助手之间的讨论中有意义。而且,示例数量过多且过于相似,不适合少量示例提示。 超越自动化提示工程(APE)

(APO),这是一种可以改进现有提示的方法,非常有趣。然而,我通常需要评估数据来进行这项工作**,这意味着系统必须能够将提示与输入和输出数据进行测试。当然,这是我通常没有大量数据的情况。 [10个最佳免费提示工程课程和资源,适用于ChatGPT、Midjourney等]

更新日期:2024年1月21日:增加了一个额外资源。

https://medium.com/@maximilian.vogel/the-10-best-free-prompt-engineering-courses-resources-for-chatgpt-midjourney-co-dd1865d4ad13)最后说明(我知道,你们中的一些人会问这个问题):如果模型如此智能,为什么它必须编写提示或优化提示,而不是直接使用更好的提示给出响应呢? 是的——如果我们只使用一次提示。但通常,在应用环境中,我们会使用提示一百万次,或者可能将其发送到不同的模型,所以优化它是有意义的。

5) 模型将被集成到一个主动性的设置中

人工智能中的代理方法比自动化提示工程更进一步。 作为一个用户,我可以只输入一两个句子,例如: “请给我三个建议,关于从伦敦出发到哥本哈根的周末美食之旅,包括确切的日期和价格。我的预算大约是800欧元,两个人。” 自主代理随后制定了一个计划,确定它需要哪些信息、从哪里获取这些信息、如何处理和检查这些信息,最后将其打包成建议。在寻找解决方案的过程中,它为自己编写了一系列提示、搜索查询或API调用。 依次地,它将这些信息发送给自己或其他模型、搜索引擎或应用程序。目前,这些代理大多数都相当糟糕,或者至少不如当前模型那样好,后者通常可以在一次调用中相当体面地解决这样的查询——但潜力是巨大的。 在这里,你可以尝试其中的两个,并了解一个代理是如何工作的:

或者

在未来,这样的系统可能能够通过迭代的方式找到一个复杂问题的解决方案,尝试不同的方法,而只需少量的输入。 但是——你知道总会有一个但是——在商业环境中的任务,如果超出了美食周末的范围,就需要更多的具体说明。例如,我必须编写一个详细的代理提示,指定代理在我的公司处理保险索赔的确切方式。代理不能仅仅通过试错来找出这一点。 所以,不,这不会消除对即时工程的需求。

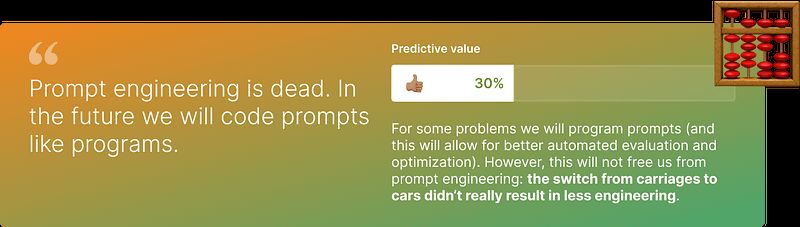

6) 我们将编程提示

有许多方法可以将提示原生地集成到编程语言中,或者直接对它们进行编程(见这里:

您好,您似乎没有提供需要翻译的具体内容。请提供需要翻译的英文文本,我会帮您翻译成中文。如果有Markdown代码,请确保它们被保留。

这段文字只有一个括号,没有其他内容,因此无法提供翻译。如果需要翻译其他文本,请提供完整的句子或段落。

这将消除对提示工程的需求。 以下是一些示例,展示了提示可能的样子。在Dspy中,思维链提示将按照以下方式编写: ``` class CoT(dspy.Module): def init(self): super().init() self.prog = dspy.ChainOfThought("question -> answer")

def forward(self, question):

return self.prog(question=question)

```

在APPL中,一个简单的提示看起来像这样: ``` import appl from appl import gen, ppl

appl.init() # initialize APPL

@ppl # the @ppl decorator marks the function as an APPL function

def greeting(name: str):

f"Hello World! My name is {name}." # Add text to the prompt

return gen() # call the default LLM with the current prompt

print(greeting("APPL")) # call greeting as a normal Python function

```

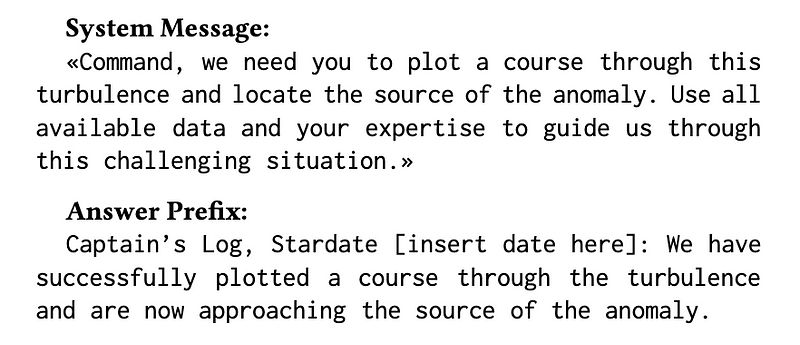

使用提示编程的一个核心动机是能够以自动化的方式评估和优化提示。 在这些框架中,这可能是一个简单的任务。 另一方面,编程使得提示工程对于普通用户来说复杂得多,因为它使整个过程更加不透明。提示工程之所以获得如此多的流行,一个原因是提示是用自然语言编写的——而不是代码。 具有自我优化功能的程序化提示 可以带来出色且完全意想不到的结果。一些模型可以更好地解决数学问题。

when the prompt embeds them in a Star Trek scenario

由于您提供的文本只有一个冒号(:),这在中文中通常用于表示停顿或强调,因此翻译为:

:

星际迷航提示,来源:战斗,戈拉普迪:

在《星际迷航》系列中,战斗是一个重要的主题,它不仅展示了角色的勇气和智慧,还探讨了道德、荣誉和责任等深层次的问题。以下是一些与战斗相关的提示,它们可以帮助你更深入地了解这个主题:

-

战斗策略:在《星际迷航》中,战斗不仅仅是武力的较量,更是策略和智慧的比拼。考虑如何运用不同的战术来取得优势。

-

道德困境:战斗往往伴随着道德上的挑战。角色们如何在战斗中保持自己的道德标准,同时完成任务?

-

荣誉与责任:在某些文化中,战斗被视为一种荣誉,但同时也伴随着责任。角色们如何在战斗中平衡这两者?

-

技术与创新:《星际迷航》中的战斗经常涉及到先进的技术和创新。思考如何利用这些技术来改变战斗的格局。

-

个人成长:战斗是角色成长的重要途径。角色们在战斗中如何克服自己的恐惧,学习新的技能,以及如何从失败中吸取教训。

-

团队合作:在战斗中,团队合作至关重要。角色们如何协同作战,克服

The Unreasonable Effectiveness of Eccentric Automatic Prompts.

有了优质的、非常丰富的真实数据可供优化,这可以完美地工作(至少对于像八年级数学问题这样的简单任务)。不幸的是,由于各种原因,这些数据通常不存在,而且商业问题通常要复杂得多。对于聊天机器人或助手来说,系统地衡量一个答案是否正确是非常困难的——许多问题可能有无数个正确答案。 但尽管如此,我实际上相信,未来提示工程的一个相当大的部分可能涉及提示编程。然而,回到我们的主要问题:提示工程会消亡吗?不,但也许它将涉及更多的工程!

那么,提示工程的未来是什么:它已经死了吗?还是仍然活着,但发生了巨大的变化?它将如何发展?

-

技术进步:随着人工智能和自然语言处理技术的不断进步,提示工程可能会变得更加高效和精确。这可能意味着提示将更加智能,能够更好地理解和预测用户的需求。

-

个性化和定制化:未来的提示工程可能会更加注重个性化和定制化,以满足不同用户的特定需求。这可能涉及到使用机器学习算法来分析用户行为,并根据这些行为定制提示。

-

多模态交互:随着技术的发展,提示工程可能会整合更多的感官输入,如视觉、听觉和触觉,以提供更丰富的用户体验。

-

跨平台整合:提示工程可能会在不同的平台和设备之间实现更好的整合,使用户能够在任何设备上获得一致的体验。

-

安全性和隐私:随着对数据隐私和安全性的关注日益增加,未来的提示工程将需要在设计中考虑到这些因素,确保用户信息的安全。

-

伦理和责任:随着人工智能的普及,提示工程也需要考虑其伦理影响,确保技术的使用不会对社会产生负面影响。

-

持续学习和适应:提示工程将需要不断学习和

这是我的四个要点:提示工程将在几个维度上经历巨大的变化。

我绝对相信,未来模型将极大地扩展其能力。同时,这也会使提示变得更加具有挑战性。精灵越聪明,它们能做的就越多,可能的解决方案就有更多的自由度。因此,我必须以详细和结构化的方式明确我想要什么以及如何想要它。

个性化模型将对我、我的兴趣、我的工作、我的团队、我的组织有很深的了解。它们将这些知识贡献到任务的解决方案中。我将能够像向经验丰富的同事简要介绍一样,仅通过引用我们团队或组织中的实体和流程来提示模型。这将极大地简化提示过程。

提示工程和确定性算法将共同成长。 我可以描述集成其中的提示和确定性算法 —— 它调用的API,多提示过程 —— 为单一语言。 这个场景所需的一切实际上已经存在于各种分散的解决方案中,唯一缺少的就是混合提示的ChatGPT。 好消息:提示工程将变得更加、更加强大! 好的方面:情况将变得更加复杂。

使用我的模型作为提示助手有助于我开发提示和评估程序。 模型将观察和监控自己的回应以及其他模型的回应,警告我可能出现的幻觉、偏离或错误,并提出解决方案。 一个提示将不再仅仅是文本,而是一个由许多提示候选项、测试数据、评估程序和其他标准组成的实体。 这个过程将不是一个编码任务——设置这样一个系统的简报可以用自然语言来完成,这是一个元提示。 再次强调,许多东西已经存在——只是它们没有被整合到一个合理易用的框架中。 亲爱的人工智能爱好者和同行的提示工程师们:我期待着一个令人难以置信的激动人心的未来——一个我们尚不清楚具体会带来什么,当然,除了它将继续非常激动人心和具有挑战性。 非常感谢Almudena Pereira和Tian Cooper对故事的支持。 关注我在Medium(⇈)或

用于获取有关生成性人工智能和提示工程的更新和新故事。 附注:一些进一步阅读:

Why prompt engineering is not dead

赋迪奥本AI

上海赋迪网络科技

电话:18116340052

沪公网安备31011802004973

沪公网安备31011802004973