奥本 AI 将所有的最新 AI 聚合到了一起,为您开启多模型 AI 绘画新时代!

扫码即刻关注公众号

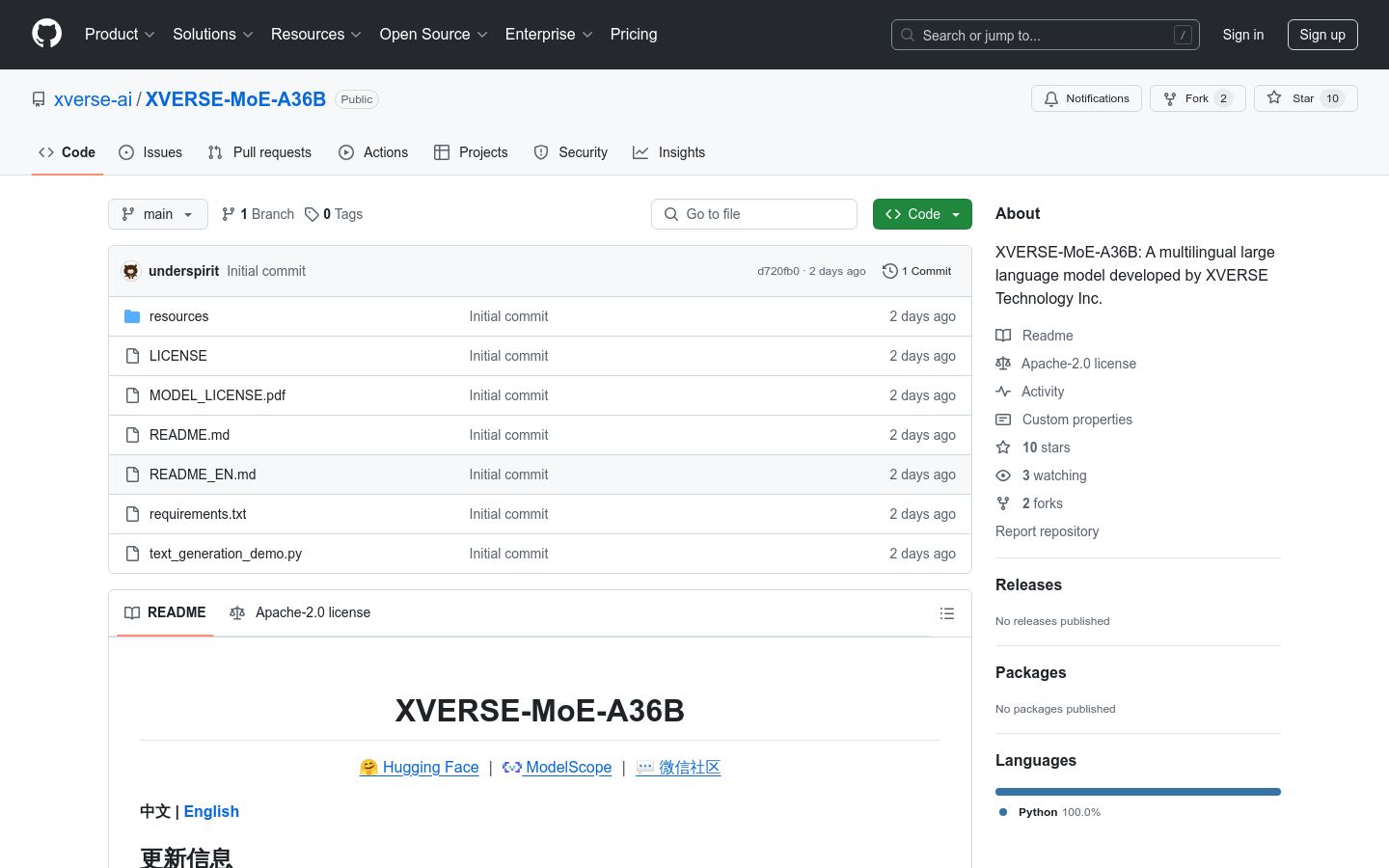

XVERSE-MoE-A36B

5 个月前

多语言大型语言模型MoE架构文本生成

XVERSE-MoE-A36B是由深圳元象科技自主研发的多语言大型语言模型,采用混合专家模型(MoE)架构,具有2554亿的总参数规模和360亿的激活参数量。该模型支持包括中、英、俄、西等40多种语言,特别在中英双语上表现优异。模型使用8K长度的训练样本,并通过精细化的数据采样比例和动态数据切换策略,保证了模型的高质量和多样性。此外,模型还针对MoE架构进行了定制优化,提升了计算效率和整体吞吐量。

赋迪奥本AI

上海赋迪网络科技

电话:18116340052

沪公网安备31011802004973

沪公网安备31011802004973