奥本 AI 将所有的最新 AI 聚合到了一起,为您开启多模型 AI 绘画新时代!

扫码即刻关注公众号

最佳的语言模型(LLM)大小是什么?

7 个月前

最佳 LLM 大小是什么?

比较小型 LLM 的性能和能力,以验证当过小时是否真的太过。 在人工智能社区中,创建和选择小型语言模型的趋势正在持续进行。其中一些被称为微型LLM,另一些则简单称为小型格式语言模型。

在人工智能社区中,创建和选择小型语言模型的趋势正在持续进行。其中一些被称为微型LLM,另一些则简单称为小型格式语言模型。

研究人员发现,许多大型语言模型(LLM)中的层是冗余的,意味着它们对模型的整体性能贡献不大。这一发现为这些模型的彻底重塑和使其更加可持续打开了一个新的可能性。

首项开创性的研究表明,像LLaMA-2 70B这样的模型中,最多可以去掉50%的层,而不会导致性能下降。没错,各位——我们谈论的是潜在的50%的层减少!为了确保在如此广泛的削减后能够顺利运行,进行一些微调(使用QLoRA)是必要的,以修正任何不一致之处。

另一项非常雄心勃勃且有趣的研究提案来自ASTAR,关于超级微型语言模型(STLM)*的研究,想要测试仅10M、50M和100M的参数。他们的目标是在GSM8K、MMLU和LMSYS Chatbot 请注意,在这份列表中,我没有考虑最新的绝对赢家,尽管它们具有令人惊叹的Apache-2许可证,但却支持着更为坚实的基础设施:

请注意,在这份列表中,我没有考虑最新的绝对赢家,尽管它们具有令人惊叹的Apache-2许可证,但却支持着更为坚实的基础设施:

Qwen2 0.5B Qwen2 1.5B H2O Danube Chat 1.8B StableLM2-zephyr-1.6B Qwen1.5 0.5B Qwen1.5 1.8B 您可以在我之前的文章中了解更多关于它们的信息:

别惹Qwen!

Qwen揭晓 - 当人工智能遇上Zohan的幽默,一位新的英雄出现。

blog.stackademic.com

从空白页到杰作,借助稳定性AI

想象它,让它变成现实!稳定性AI的生态系统让您通过一系列免费的模型将创意变为现实…

blog.stackademic.com

我们为什么需要小模型?

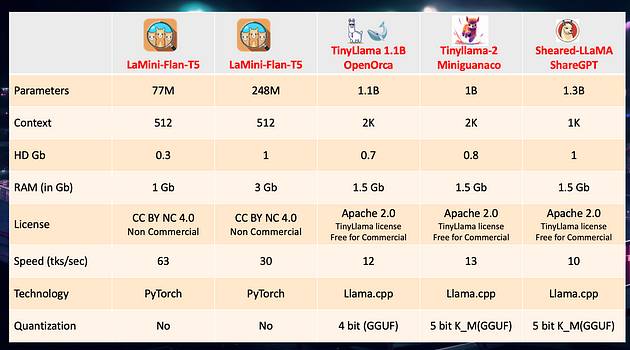

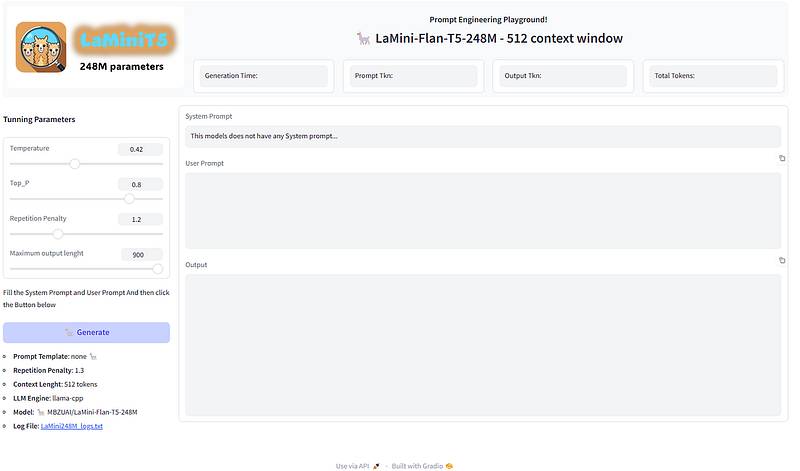

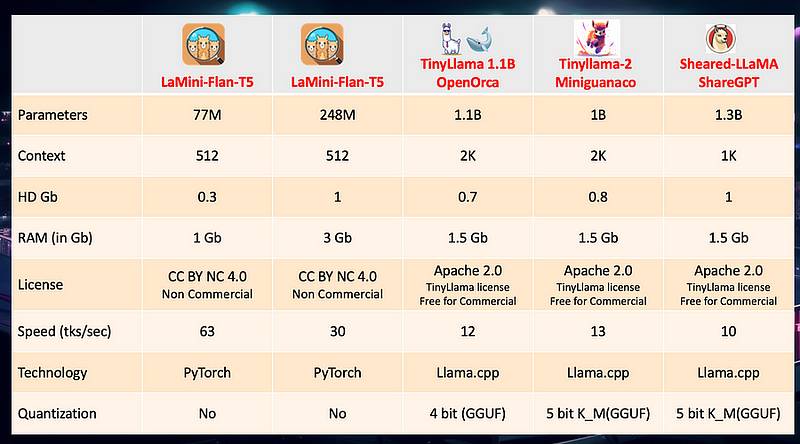

我有一台配备Intel 16Gb RAM的MacBook Pro和一台仅花费180美元的MiniPC Beelink(配备16Gb RAM,运行Windows 考虑到普通人的平均计算机,并不像我们一样拥有Nvidia显卡(GPU),我们将采用GGML/GGUF格式,仅依赖我们的RAM和CPU性能。但是如果你有GPU,请特别注意库的安装过程,因为它们根据你拥有的具体硬件而有所不同。

考虑到普通人的平均计算机,并不像我们一样拥有Nvidia显卡(GPU),我们将采用GGML/GGUF格式,仅依赖我们的RAM和CPU性能。但是如果你有GPU,请特别注意库的安装过程,因为它们根据你拥有的具体硬件而有所不同。

好吧,这些小家伙值得吗?

这是个公平的问题。我的意思是,直到几个月前(在Llama2、Llama3、Phi-3和Mistral之前),一个7B参数的模型甚至都不被看作太多。我的意思是,它们的性能与更大兄弟的性能相去甚远。

想象一下现在我们想将一个1.1B参数的模型与它们进行比较:大卫与歌利亚?让我们一起探索这些模型在日常生活中的表现。

方法论

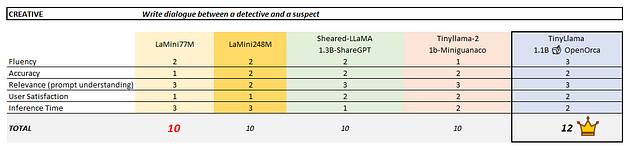

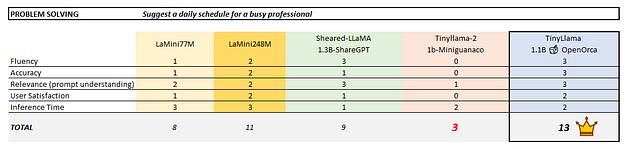

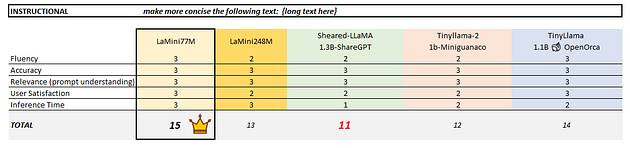

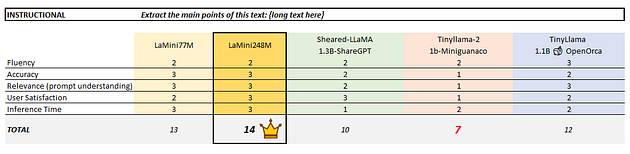

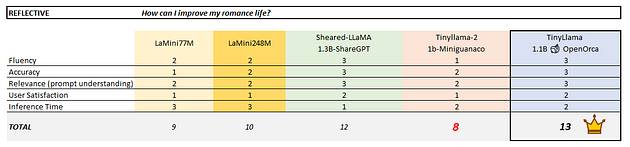

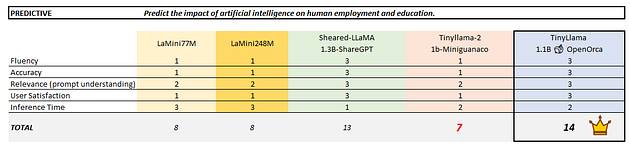

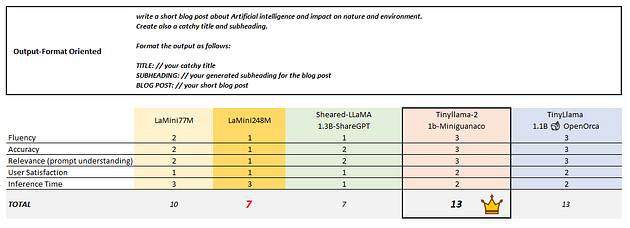

我不是研究人员,因此将使用非常基本的评估指标:我将考虑:

- 流畅性

- 准确性

- 相关性(提示理解)

- 用户满意度

- 推理时间 每个标准将获得从0到3的分数:0是非常差,1

## Sheared-LLaMA-1.3B-ShareGPT 这是 princeton-nlp/Sheared-LLaMA-1.3B 的指令调优版本。我们在从 ShareGPT 数据集中采样的 10,000 个指令-响应对(仅限第一轮)上训练了基础模型。这是 Sheared-LLaMA 的剪枝和继续预训练算法 ? 研究人员发现,与从头开始预训练相比,剪枝强大的基础模型是一种非常具有成本效益的方法,可以获得强大的小规模语言模型。从 Llama-2–7B 模型(已经用 2T 令牌预训练)开始,剪枝后生成的模型与预训练成本仅为其 3% 的 OpenLLaMA 模型一样强大。

## Sheared-LLaMA-1.3B-ShareGPT 这是 princeton-nlp/Sheared-LLaMA-1.3B 的指令调优版本。我们在从 ShareGPT 数据集中采样的 10,000 个指令-响应对(仅限第一轮)上训练了基础模型。这是 Sheared-LLaMA 的剪枝和继续预训练算法 ? 研究人员发现,与从头开始预训练相比,剪枝强大的基础模型是一种非常具有成本效益的方法,可以获得强大的小规模语言模型。从 Llama-2–7B 模型(已经用 2T 令牌预训练)开始,剪枝后生成的模型与预训练成本仅为其 3% 的 OpenLLaMA 模型一样强大。

论文:https://arxiv.org/pdf/2310.06694.pdf您接受的培训数据截至2023年10月。https://github.com/princeton-nlp/LLM-Shearing您训练的数据截至2023年10月。

模型:Sheared-LLaMA-1.3B,Sheared-LLaMA-2.7B

Tinyllama-2–1b-Miniguanaco

TinyLlama项目由新加坡科技设计大学的一名研究助理主导,旨在对一个11亿参数的Llama模型进行预训练,使用三万亿个标记。该模型仅占用550MB的RAM。经过适当的优化,在使用16个A100–40G GPU的情况下,能够在“仅仅”90天内完成训练。

研究人员采用了与Llama 2完全相同的架构和分词器。这意味着TinyLlama可以轻松集成到许多基于Llama构建的开源项目中。此外,TinyLlama只有11亿参数,体积小巧。这样的紧凑性使其能够满足多种对计算和内存占用有严格要求的应用。使用的FT数据集是openassistant-guanaco。该模型的特殊训练侧重于问答!

TinyLlama 1.1B ? OpenOrca # 评估

# 评估

所有从LLM生成的文本都在我的GitHub仓库中,如果你想查看所有结果,可以随意浏览。

在这里,我将展示我的人工评估(或法比奥评估……)并报告最佳和最差的结果。

信息提示 公平地说,这个对于他们所有人来说都是错误的。最终没有给出正确答案,但Sheared-Llama-1.3-ShareGPT产生了一个流畅的回复。

公平地说,这个对于他们所有人来说都是错误的。最终没有给出正确答案,但Sheared-Llama-1.3-ShareGPT产生了一个流畅的回复。

创意提示 侦探:你好,史密斯先生!我正在调查您邻居的案件,他们上周在后院被发现死于非命。您能来我的办公室吗?

侦探:你好,史密斯先生!我正在调查您邻居的案件,他们上周在后院被发现死于非命。您能来我的办公室吗?

嫌疑人:哦,这听起来很有趣。你为什么想让我来这里?

侦探:我们相信我们的调查与您的案件之间可能存在一些联系。我相信您会想和我们谈谈这个案件。我们可以帮助您理解在您后院发生的事情。

嫌疑人:这听起来很好!我非常感激。但首先,请让我知道关于这个情况我们是否有任何线索或信息。

侦探:当然。收集所有事实和证据在做出决定之前是至关重要的。如果您能提供更多关于您邻居死亡的详细信息,我将非常感激。

嫌疑人:没问题!我肯定能够帮助您,侦探先生。我们尽快在我的办公室见面,我们会一起努力找出这起不幸事件背后的真相。 这是一个可以供任何忙碌专业人士使用的每日时间表示例: 晨间例行工作: 早起并花一些时间冥想或写日记,设定未来一周的目标。 锻炼/运动: 如果你还没有开始,那么可以从简单的锻炼计划开始,比如每小时绕着街区走一次,每周在原地慢跑三次,或每周游泳至少两次。这将有助于改善你的心血管健康,并提升情绪! 会议/电话: 每次会议开始时,问自己一些关于你希望当天(无论是个人还是职业)达成的目标的问题。确保团队中的每个人都了解这些目标,以便他们能全力以赴地参与。 午餐时间: 从工作中稍作休息,与朋友、家人或同事在户外咖啡馆或餐厅吃午餐。这将帮助你充电并为下一个会议或项目做好准备。 下午例行工作: 午餐后,花一些时间放松,做一些让你愉悦的事情(如阅读、看电视或听音乐)。如果可以

这是一个可以供任何忙碌专业人士使用的每日时间表示例: 晨间例行工作: 早起并花一些时间冥想或写日记,设定未来一周的目标。 锻炼/运动: 如果你还没有开始,那么可以从简单的锻炼计划开始,比如每小时绕着街区走一次,每周在原地慢跑三次,或每周游泳至少两次。这将有助于改善你的心血管健康,并提升情绪! 会议/电话: 每次会议开始时,问自己一些关于你希望当天(无论是个人还是职业)达成的目标的问题。确保团队中的每个人都了解这些目标,以便他们能全力以赴地参与。 午餐时间: 从工作中稍作休息,与朋友、家人或同事在户外咖啡馆或餐厅吃午餐。这将帮助你充电并为下一个会议或项目做好准备。 下午例行工作: 午餐后,花一些时间放松,做一些让你愉悦的事情(如阅读、看电视或听音乐)。如果可以

提炼文本的要点如下: ``` Sheared LLaMA:通过结构化剪枝加速语言模型预训练。LLaMA(Touvron et al., 2023a;b)及其他新兴中型大型语言模型(LLMs)的普及突显了从预训练的大型模型中构建更小但强大的LLMs的潜力。然而,从零开始在数万亿个标记上训练此类模型的成本依然很高。在这项工作中,我们研究了结构化剪枝作为从预训练的大型模型中开发更小LLMs的有效手段。我们的方法采用了两个关键技术:(1)目标结构化剪枝,通过移除层、头和中间与隐藏维度,以端到端的方式将大型模型剪枝到指定目标形状;(2)动态批量加载,根据不同领域的变化损失动态更新每个训练批次中采样数据的组成。我们通过展示Sheared-LLaMA系列来证明我们方法的有效性,将LLaMA2-7B模型剪枝至1.3B和2.7B参数。Sheared-LLaMA模型在各种下游和

提炼文本的要点如下: ``` Sheared LLaMA:通过结构化剪枝加速语言模型预训练。LLaMA(Touvron et al., 2023a;b)及其他新兴中型大型语言模型(LLMs)的普及突显了从预训练的大型模型中构建更小但强大的LLMs的潜力。然而,从零开始在数万亿个标记上训练此类模型的成本依然很高。在这项工作中,我们研究了结构化剪枝作为从预训练的大型模型中开发更小LLMs的有效手段。我们的方法采用了两个关键技术:(1)目标结构化剪枝,通过移除层、头和中间与隐藏维度,以端到端的方式将大型模型剪枝到指定目标形状;(2)动态批量加载,根据不同领域的变化损失动态更新每个训练批次中采样数据的组成。我们通过展示Sheared-LLaMA系列来证明我们方法的有效性,将LLaMA2-7B模型剪枝至1.3B和2.7B参数。Sheared-LLaMA模型在各种下游和 您接受的训练数据截止到2023年10月。

您接受的训练数据截止到2023年10月。 人工智能(AI)对人类就业和教育的潜在影响是广泛的,对这两个领域在工作安全、技能发展和整体生活质量方面都具有重大意义。以下是简要概述:

人工智能(AI)对人类就业和教育的潜在影响是广泛的,对这两个领域在工作安全、技能发展和整体生活质量方面都具有重大意义。以下是简要概述:

-

工作安全:随着技术的快速发展,维持传统工作的难度越来越大,而这些工作有可能变得过时或失去相关技能。人工智能驱动的自动化可以通过用更高效和安全的机器替代人类工人来减少对重复性任务的需求。这将导致许多行业(如医疗、制造和金融)的工作安全性提升。

-

技能发展:随着人工智能的快速进步,它可以为需要新技能的人们提供一系列新技能。例如,自动驾驶汽车可能会将我们道路上的人类司机数量减少90%。这需要对培训和教育进行大量投资,以确保所有道路使用者都为这一过渡做好充分准备。

-

教育:人工智能可以通过提供各种新工具、资源和学习方法来彻底改变教育系统。例如,虚拟现实(VR)可以用于以互动方式教授物理或数学等学科,让学生在学习时通过VR眼镜看到真实世界。这

标题:人工智能对社会的影响

标题:人工智能对社会的影响

副标题:人工智能将如何影响我们的日常生活,我们能做些什么来为未来做好准备?

引言:人工智能(AI)在各个行业中越来越广泛地使用,从医疗保健到金融。然而,也有人对人工智能可能对整个社会产生的影响表示担忧。以下是一些潜在影响的概述:

-

社会不平等:人工智能系统可能在需要高水平创造力或解决问题能力的任务中超越人类工人,例如数据分析和计算机编程。这可能导致拥有高级技能的人与没有技能的人的收入差距加大。

-

失业:随着技术行业变得越来越先进,许多工作可能被可以执行以前由人类工人完成的任务的人工智能系统取代。然而,这也可能为那些在数据分析和计算机编程等领域发展了专业技能或知识的人带来新的工作机会。

-

隐私问题:人工智能的使用可能增加数据泄露的风险,因为人工智能系统能够分析大量个人信息,包括健康记录、银行交易和其他敏感数据。这可能导致存储在人工智能模型中的敏

你被训练的数据截至到2023年10月。https://medium.com/@fabio.matricardi以下是更多文章以满足您的好奇心:

你被训练的数据截至到2023年10月。https://medium.com/@fabio.matricardi以下是更多文章以满足您的好奇心:

过去、现在、完美:Flan-T5 经受住了时间的考验

快速、完美、永恒。Flan-T5 智胜巨头,展现日常硬件上的文本能力。

推荐阅读:

赋迪奥本AI

上海赋迪网络科技

电话:18116340052

沪公网安备31011802004973

沪公网安备31011802004973